La inteligencia artificial ha entrado en nuestra vida cotidiana como una presencia constante, eficiente y casi invisible. Pero, ¿qué pasa cuando le cedemos nuestras decisiones más pequeñas y personales?

¿Se han convertido las relaciones con mucha diferencia de edad en una ‘red flag’ para los jóvenes?

Si durante las primeras décadas de la existencia de Internet se instaló en nosotras un miedo y un recelo sobre qué cosas debíamos compartir online —ya que nunca sabes quién podría estar mirando—, ChatGPT y otras inteligencias artificiales han llegado a nuestras vidas como un espacio donde volcar toda nuestra información sin demasiadas reservas. En estos días en los que se discute mucho sobre aquellos empleos que van a ser desplazados por la IA o de los vínculos afectivos que algunas personas están entablando con chatbots, estamos dejando a un lado el impacto de su uso en las cosas más pequeñas —y aparentemente insignificantes— de nuestra cotidianeidad.

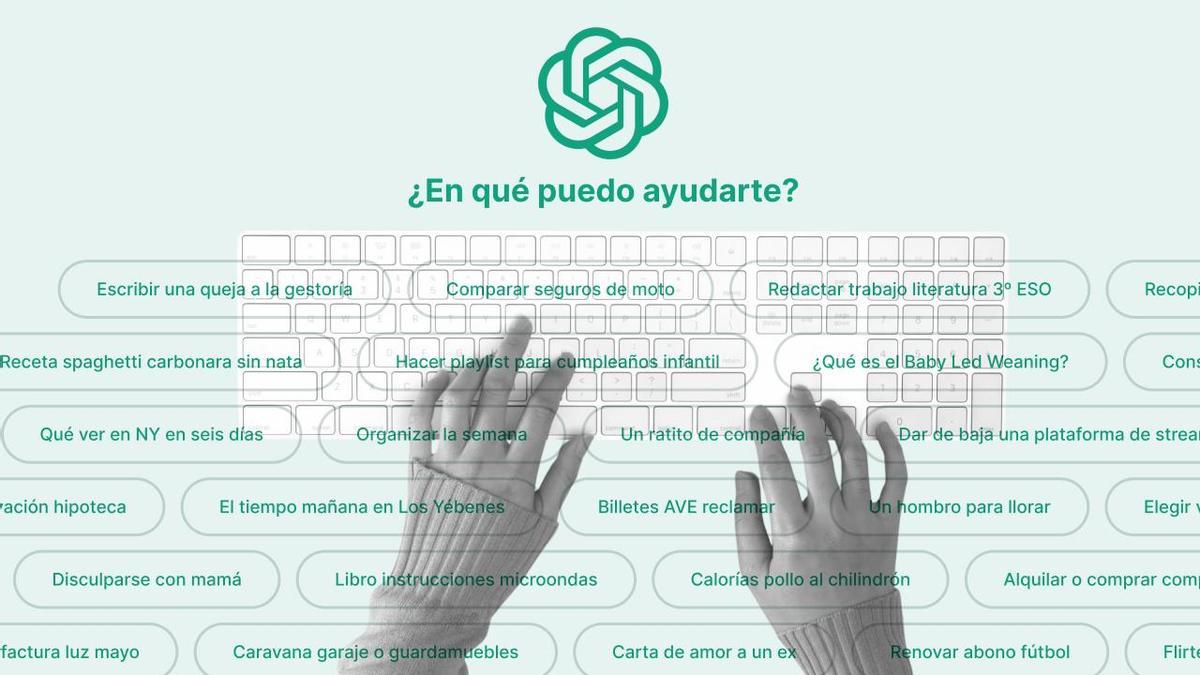

“Hola, hazme una comparativa entre estos dos seguros”, “traza una ruta por los lugares más emblemáticos de esta ciudad”, “dame tres recetas diferentes cuyo ingrediente principal sea la quinoa” o “redacta este mail en un tono que imponga autoridad, pero que sea cercano al mismo tiempo” son algunas de los miles de dudas distintas que cada día reciben ChatGPT (y sucedáneos). Pero, ¿qué ocurre en el momento en que empezamos a desarrollar un cierto grado de dependencia con relación a las decisiones más pequeñas de nuestro día a día? ¿Hasta qué punto se modifica nuestra cotidianeidad y nuestra propia identidad? ¿Y por qué hemos naturalizado de forma tan rápida acudir a ChatGPT con información y dudas personales, frente al largo camino lleno de dudas e inseguridades que recorrimos cuando aterrizó Internet?

Una respuesta fácil para todo

En el año 2023, varios investigadores del Instituto Allen de Inteligencia Artificial lanzaron el proyecto WildChat, en el que ofrecían acceso gratuito al modelo GPT-4 —el más avanzado actualmente y disponible por 20 dólares mensuales— a cambio de tener consentimiento para recopilar las consultas de los usuarios de forma anónima.

Este estudio, en el que participaron más de 200 mil usuarios y en el que analizaron más de un millón de conversaciones, muestra una amplia gama de casos de uso. Según los datos ofrecidos sobre el análisis de las categorías de prompts principales —las indicaciones iniciales que se proporcionan a la IA—, en las primeras interacciones de conversaciones se mostró que un 61,9% de consultas estaban relacionadas con la escritura asistida y creativa, es decir, la redacción de ensayos, ayuda con tareas escolares, guiones, correos, etc.; un 13,6% sobre el análisis y la toma de decisiones; un 6,7% se destinaban a las explicaciones de conceptos, ideas o eventos; un 6,3% a la ayuda con programación y un 6,1% con la información factual y el razonamiento matemático.

Entre estas opciones se encuentran los usos de ChatGPT que hace Clara, de 39 años, en su día a día. Ella reconoce que empezó a utilizarlo de forma gradual, pero que ahora está muy presente en su vida: “Primero lo usé para ayudarme a estructurar trabajos escritos y búsqueda de bibliografía, pero luego me di cuenta de que funcionaba muy bien para las recetas de cocina y cómo adaptarlas a la Thermomix, ya que tengo una bebé que hace Baby Led Weaning —un método de introducción de alimentos sólidos en la dieta del bebé—. También me prepara las maletas para los viajes, analiza partituras musicales, redacta emails formales, lo uso para aprender idiomas e incluso para una consulta de salud a la que mi médico de cabecera no me pudo dar solución”.

De la misma forma, Gonzalo (nombre ficticio), de 29 años, explica que también hace un uso muy diverso de la herramienta, no solo para cuestiones técnicas de su trabajo, sino también para saber “cuánta comida debo dar a mis gatos, cómo cocinar unas tortitas, redactar mails o aprender a usar una cámara profesional”. Reconoce que “cuando llegó a mi vida, al principio preguntaba alguna cosa por curiosidad, pero llegó un punto en el que pasó a ser mi principal fuente de información”.

Cuando llegó a mi vida, al principio preguntaba alguna cosa por curiosidad, pero llegó un punto en el que pasó a ser mi principal fuente de información

El uso de la Inteligencia Artificial está cada vez más presente en nuestras vidas, y lo hace desde una edad más temprana. Según la publicación Inteligencia Artificial: ¿Una amenaza para el cerebro infantojuvenil y el aprendizaje?, de Norton Contreras Paredes, académico e investigador de la Escuela de Educación Inicial y la Facultad de Educación de la Universidad Católica Silva Henríquez, nuestro aprendizaje se produce en colaboración con otras y otros, lo que en términos psicológicos se conoce como Zona de Desarrollo Próximo (ZDP). Es decir, en una situación ideal, todo ejercicio educativo debiera propiciar conversaciones grupales y la adquisición de significados propios del aprendizaje social. Sin embargo, “estos avances tecnológicos parece que podrían generar un realce de la individualidad y un potencial desequilibrio en la experiencia educativa”.

En una conversación con este diario, Contreras Paredes explica que, aunque existen buenos usos de la IA, acudir a ella para “realizar tareas cotidianas que, habitualmente, requieren un alto esfuerzo cognitivo —como redactar correos, planificar viajes o buscar información— puede generar a mediano y largo plazo un debilitamiento importante de algunas funciones cognitivas tales como los sistemas de memoria y de nuestras funciones ejecutivas”. El investigador explica que “nuestro cerebro funciona como un músculo que, al igual que cualquier otro, requiere ejercicio constante para poder mantenerse en óptimas condiciones. Un ejercicio que no siempre es aportado por las herramientas digitales”, y que es esta ejercitación “la que nos permitirá garantizar una reserva cognitiva que nos será muy útil cuando debamos afrontar, por ejemplo, los efectos propios del envejecimiento en nuestro sistema nervioso”.

La inteligencia artificial nos enfrenta a una situación paradójica respecto al esfuerzo cognitivo que llevamos a cabo. Y es que, aunque la IA promete ahorrar tiempo —una de las cualidades más mencionadas en los motivos de su uso— y facilitar tareas complejas, muchas veces gastamos más recursos mentales en interactuar con ella de la forma más eficiente posible —qué prompt o información proporcionarle para que su respuesta se ajuste a nuestras necesidades— que en analizar o comprender las respuestas que obtenemos.

Acudir a la IA para realizar tareas cotidianas que, habitualmente, requieren un alto esfuerzo cognitivo —como redactar correos, planificar viajes o buscar información— puede generar un debilitamiento importante de algunas funciones cognitivas

Esta es una paradoja de la que se da cuenta Gonzalo al reflexionar sobre el uso efectivo de su tiempo y el esfuerzo mental invertido en ella: “A pesar de que me facilita unas cosas, yo también hago el esfuerzo de decir: ‘¿cómo puedo conseguir el mejor prompt? ¿Cómo puedo masticarle toda la información para conseguir el mejor resultado?’. No sirve poner palabras aleatorias para que te dé el texto mejorado, sino que hay que hacer un esfuerzo en pensar cómo se lo puedes escribir todo para que conteste de la mejor forma posible, algo que reconozco que también lleva un tiempo, aunque sea menor”. Ante esta situación, encontramos que “nuestro cerebro destina una gran cantidad de recursos cognitivos al uso de las herramientas digitales en sí mismas, en vez de utilizarlos en la realización de una tarea que implica el esfuerzo cognitivo en sí mismo”, explica el investigador en neuroeducación.

Mucha información y pocos filtros

Además de los efectos a corto y largo plazo en el individuo, utilizar la inteligencia artificial nos enfrenta a otra cuestión relevante: ¿qué pasa con esa información que estoy constantemente proporcionando? ¿A quién estoy revelando mis intereses vacacionales, mis ideas, mis problemas de salud o los datos con información relevante para mi trabajo? Si antes recibíamos mensajes de forma habitual sobre la importancia de nuestra privacidad en Internet, el tipo de modelo conversacional bajo el que funcionan muchos chatbots crea una sensación de espacio seguro en el que puedes hablar sobre cualquier tema con ese ente-otro indefinido, que aparentemente va a mantener a salvo cualquier tipo de información que le proporciones.

Sin embargo, Lorena Fernández Álvarez, ingeniera informática con un máster en seguridad de la información y en el programa Experto en Ética de la Digitalización y de la Inteligencia Artificial Aplicada, explica que toda esta información no se queda ahí, sino que se la estamos entregando a las grandes tecnológicas: “Si bien es cierto que en muchas de las herramientas podemos habilitar, por ejemplo, que la información que usamos en las conversaciones no se use en un futuro para entrenar a los algoritmos vía generativa, esta es una funcionalidad poco conocida por la mayoría de usuarios”. Esto no significa que ChatGPT esté aprendiendo con nuestras conversaciones constantemente, sino que estamos aceptando indirectamente que nuestra información sirva para un entrenamiento futuro del modelo y su red neuronal.

Todo ello sin tener en cuenta que “estamos confiando en una empresa como OpenAI, que lo que primero que hizo fue un extractivismo total de información de Internet, independientemente de que tuviera copyright o no, derechos de autor, etc.”. Por ello, “siempre se le recuerda a la gente, y esto es importantísimo, que independientemente de que le diga al modelo que no utilice esas conversaciones para futuros entrenamientos, nunca jamás meta información personal, ya sea información médica, bancaria, contraseñas, datos personales, etc.”, explica Fernández Álvarez. “Porque ya no sólo es la problemática de un futuro entrenamiento de la IA, sino que hay que entender también cómo funcionan los entrenamientos o los refinados de estos modelos, en los que a veces también intervienen personas que podrían llegar a ver esa información durante el proceso”.

Independientemente de que le diga al modelo que no utilice esas conversaciones para futuros entrenamientos, nunca jamás meta información personal (médica, bancaria, contraseñas, datos personales…)

Dar a conocer que en algunas fases del refinamiento intervienen personas —con unos trabajos mal pagados y muy precarios— es algo que no interesa a las grandes empresas tecnológicas que están detrás, ya que ellas salen favorecidas cuando concebimos ChatGPT (y derivados) como una especie de deidad que todo lo sabe, para que muchas personas lo sigan utilizando “confiando a ciencia cierta en que lo que se está diciendo es real”, advierte esta experta en digitalización e inteligencia artificial aplicada.

La falta de conciencia a la hora de compartir nuestra información también se manifiesta en tendencias o modas como la de subir fotografías para que la IA las convierta en imágenes al estilo Ghibli, que inundó las redes sociales hace varias semanas. Esto no solo pudo considerarse como una respuesta estratégica a las declaraciones de Hayao Miyazaki, quien criticó el uso de la inteligencia artificial, sino que se convierte en una problemática en el momento en que estamos cediendo una información tan valiosa como nuestro propio rostro. Nuestra cara es “un elemento de privacidad para todo el tema de reconocimiento facial, que es, precisamente, una de las cosas que se están abordando con la regulación europea en relación con la IA, porque pueden ser modelos de control en un futuro”, explica Fernández Álvarez.

Por lo tanto, al igual que todo lo que implica la incursión de las nuevas tecnologías en nuestra vida, incluso para las cuestiones más pequeñas e insignificantes, hay que permitirse un momento de reflexión y de crítica sobre el lugar que ocupan y sobre las posibles consecuencias de hacer uso de ellas. No hay que pretender desechar la inteligencia artificial de nuestro día a día, si es que todavía existe esa posibilidad —que poco a poco se parece más a una realidad utópica—, sino que debemos buscar y aspirar a un tipo de IA más ética y pensada desde y para las personas, sin sesgos, discriminaciones y más respetuosa con el medio ambiente. Y, sobre todo, ser conscientes de que cada pregunta rápida tiene un precio, y que está en nuestra mano decidir cuánto queremos pagar.